Quo Vadis, Action Recognition? A New Model and the Kinetics Dataset

João Carreira, Andrew Zisserman — CVPR 2017 (University of Oxford)

I3D 是视频理解发展史上的关键转折点。它没有简单地在 3D 卷积和双流网络之间二选一,而是提出一个更有延续性的思路:把成熟的 2D 图像识别网络直接“膨胀”为 3D 视频网络。这样模型既能继承 ImageNet 预训练带来的强表征能力,又能显式学习时间维度上的运动信息。

这篇论文的另一项同等重要的贡献,是同步推出大规模动作识别数据集 Kinetics。I3D 与 Kinetics 一起出现,本质上是在回答同一个问题:视频模型不仅要有更合理的时空结构,也要有足够大的预训练土壤。此后,“先在大规模视频数据上预训练,再迁移到下游任务”逐渐成为视频理解的主流范式。

研究动机

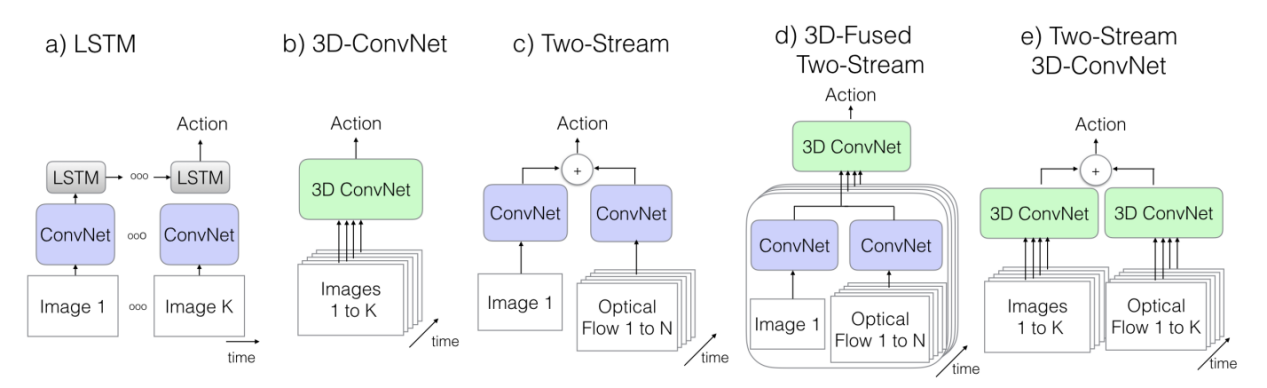

在 I3D 之前,视频动作识别主要沿着两条路线发展:

- 3D ConvNet:直接在时间、高度、宽度三个维度上做卷积,理论上最自然,但训练成本高、参数量大、容易受限于数据规模。

- Two-Stream:一条 2D CNN 处理 RGB 外观,一条 2D CNN 处理光流运动,效果强,但时间建模更多依赖输入设计,网络内部并没有统一地学习时空特征。

作者想解决的核心矛盾是:2D 图像模型已经在 ImageNet 上训练得很强,但视频模型却很难直接复用这些能力。如果从头训练 3D 网络,数据需求和优化难度都会迅速上升;如果继续停留在 2D 双流框架里,又难以在网络内部真正进行时空联合建模。

从这张架构对比图可以看出,LSTM、纯 3D ConvNet、传统双流、3D 融合双流都在尝试回答同一个问题:如何同时建模外观与运动。I3D 给出的答案是 Two-Stream 3D-ConvNet:保留双流分工,但把每个分支内部都升级为 3D ConvNet。

核心方法/模型架构

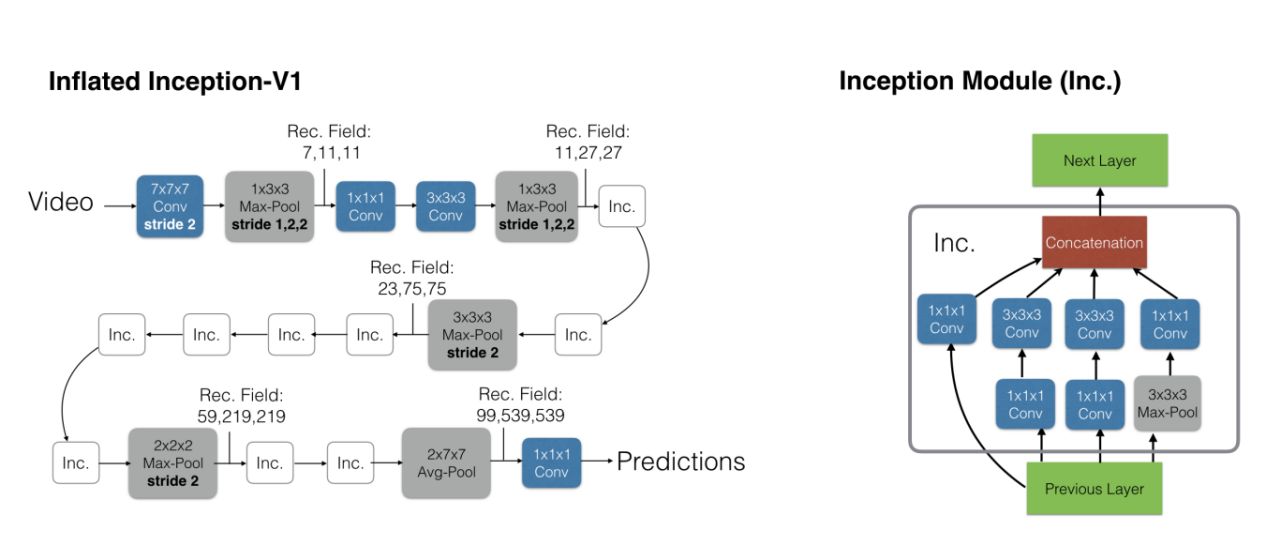

I3D 的整体结构可以概括为一句话:把 Inception-V1 这样的 2D CNN 膨胀为 3D CNN,并分别用于 RGB 流与光流流。这样每个分支都不再只是处理单帧,而是直接处理短视频片段,在网络内部学习时空特征。

其中最关键的初始化思想是 inflation。若 2D 卷积核权重为 ,那么可以把它沿时间维复制为长度 的 3D 卷积核:

这个除以 的步骤非常关键。它保证当输入是一段由同一帧重复得到的“静态视频”时,3D 卷积的输出与原始 2D 卷积保持同量级,而不会因为时间维重复累加导致激活值被放大。

从系统层面看,I3D 的架构包含三个互相配合的决定:

- Inception 主干保留:延续 Inception 的多分支设计,让模型能在同一层里捕获不同感受野的模式。

- 2D 到 3D 的平滑迁移:卷积核和池化层都扩展到时间维,从而把图像模型迁移为视频模型。

- 双流输入:RGB 流负责外观,光流流负责运动,最后在预测层进行融合。

组件详解

Inflation:2D 卷积核如何变成 3D 卷积核

I3D 最核心的工程洞见不是“直接上 3D”,而是“怎么让 2D 预训练权重合理地进入 3D 网络”。如果把一个 卷积核直接扩展为 ,最自然的方式就是在时间维上复制多份,再做均值缩放。

这一步的价值有两层:

- 参数初始化更稳定:3D 网络不必从随机权重起步。

- 预训练知识可迁移:ImageNet 上学到的边缘、纹理、局部语义等能力可以直接继承到视频网络里。

从今天回看,I3D 真正重要的不只是一个具体模型,而是它证明了:图像预训练并不一定只能服务于图像任务,只要结构设计得当,也可以迁移到视频时空建模。

池化策略:先降空间,不急着降时间

论文里一个很重要但容易被忽略的细节是:时间维不要过早下采样。因此 I3D 中常见的池化设置是 ,也就是只在空间维做聚合,先尽量保留时间分辨率。

这么做的原因很直接:动作识别真正区分类别的,往往不是单帧长什么样,而是连续帧之间怎么变化。如果太早压缩时间维,模型还没来得及学到稳定运动模式,就已经把关键信息丢掉了。

双流结构:外观与运动分开建模

I3D 没有抛弃 Two-Stream 的基本判断,而是把它升级了。两个分支的职责仍然非常清晰:

- RGB 流:输入视频 RGB 帧,学习场景、物体、人体姿态等外观线索。

- 光流流:输入连续帧计算得到的光流,学习显式运动信息。

与 2014 年的 Two-Stream 相比,差别在于这两条流内部不再只是 2D CNN,而是完整的 3D ConvNet。也就是说,每个分支自己就在做时空联合建模,而不是把时间信息主要寄托给输入堆叠。

Inception 模块:多尺度时空特征抽取

I3D 继承的是 Inception-V1 主干,因此它天然保留了多分支特征抽取的优点。不同分支可以关注不同尺度的局部模式,再在通道维上聚合。

这使 I3D 兼具两种优势:

- 结构上更高效:相比单一路径不断堆深,Inception 的多分支设计更善于在相近参数预算下组织多尺度信息。

- 表达上更灵活:视频里的动作可能既依赖短时局部变化,也依赖更粗粒度的时空模式,多分支结构更容易同时覆盖这些情况。

Kinetics:和 I3D 同等重要的第二贡献

论文标题里除了新模型,还明确写了 “the Kinetics Dataset”。这不是附带贡献,而是与 I3D 同等级别的工作。Kinetics 为视频理解提供了接近 ImageNet 在图像领域所扮演的角色:一个足够大、足够通用、足以支持预训练迁移的数据基座。

这意味着 I3D 的成功并不是单靠架构创新完成的,而是“模型设计 + 数据规模”共同作用的结果。很多后续工作真正沿用的,既包括 inflation 这种结构思想,也包括先在 Kinetics 上预训练再微调的训练范式。

实验结果

I3D 的实验结论可以概括为三个层次。

第一,把 2D 网络膨胀为 3D 网络是有效的。这说明 time dimension 不是简单增加一个轴而已,而是能让模型在保持预训练优势的同时学到真实的时空模式。

第二,RGB 流与光流流具有稳定互补性。RGB 更擅长外观,光流更擅长运动,二者融合后的表现显著强于单流模型。这一点延续了 Two-Stream 的基本判断,但 I3D 让这种互补关系发生在更强的 3D 分支之上。

第三,Kinetics 预训练带来了很强的迁移能力。论文最重要的历史意义之一,不是某一个 benchmark 上比前人高了多少,而是它证明了:视频理解也可以像图像理解一样建立预训练—微调范式。这一点对后来的 SlowFast、Video Swin、Video Transformer 都有深远影响。

如果只看方法演进,I3D 可以被理解为“Two-Stream + 3D ConvNet + 大规模预训练”的交汇点;如果看研究范式,它则是视频理解从“小数据集技巧”走向“可迁移预训练”的起点之一。

总结

I3D 的核心贡献可以压缩为三句话:

- 它把 2D CNN 平滑迁移为 3D CNN,解决了视频模型难以利用图像预训练的问题。

- 它保留并升级了双流结构,让外观与运动都在 3D 网络内部完成时空建模。

- 它和 Kinetics 一起建立了视频预训练范式,把视频理解推进到更大规模、更可迁移的阶段。

当然,I3D 的局限也很清晰:3D 卷积计算和显存开销高,双流方案依然依赖光流预处理,长时程建模能力也受到卷积感受野的限制。但正因为 I3D 把问题拆得足够清楚,后续方法才得以继续沿着“更强时空建模、更低工程成本、更大规模预训练”三个方向推进。

代码实战

为了把论文中的结构思想落到可运行代码,我配套实现了一份教学型 Notebook。它不是原论文的全量工业复现,而是聚焦三个最重要的问题:inflate 如何实现、3D Inception block 如何组织、I3D-like 分类器如何跑通。

完整代码实战:

第一段最关键的代码,是把 2D 卷积核膨胀为 3D 卷积核的初始化逻辑:

def inflate_conv2d_to_conv3d(conv2d, time_dim=3):

conv3d = nn.Conv3d(

in_channels=conv2d.in_channels,

out_channels=conv2d.out_channels,

kernel_size=(time_dim, conv2d.kernel_size[0], conv2d.kernel_size[1]),

stride=(1, conv2d.stride[0], conv2d.stride[1]),

padding=(time_dim // 2, conv2d.padding[0], conv2d.padding[1]),

bias=conv2d.bias is not None,

)

with torch.no_grad():

w2d = conv2d.weight.data

w3d = w2d.unsqueeze(2).repeat(1, 1, time_dim, 1, 1)

w3d = w3d / time_dim

conv3d.weight.copy_(w3d)

if conv2d.bias is not None:

conv3d.bias.copy_(conv2d.bias.data)

return conv3d这段代码完整体现了 I3D 的核心直觉:不是重新发明一个完全不同的视频网络,而是把已有的 2D 能力系统化地带入 3D。

第二段关键代码是教学版的 3D Inception block。它保留了多分支结构,同时把 (1, 3, 3) 的时间保留池化写得非常直观:

class InceptionBlock3D(nn.Module):

def __init__(self, in_channels, c1, c3r, c3, c5r, c5, pool_proj):

super().__init__()

self.branch1 = BasicConv3d(in_channels, c1, kernel_size=1)

self.branch2 = nn.Sequential(

BasicConv3d(in_channels, c3r, kernel_size=1),

BasicConv3d(c3r, c3, kernel_size=3, padding=1),

)

self.branch3 = nn.Sequential(

BasicConv3d(in_channels, c5r, kernel_size=1),

BasicConv3d(c5r, c5, kernel_size=3, padding=1),

)

self.branch4 = nn.Sequential(

nn.MaxPool3d(kernel_size=(1, 3, 3), stride=1, padding=(0, 1, 1)),

BasicConv3d(in_channels, pool_proj, kernel_size=1),

)

self.out_channels = c1 + c3 + c5 + pool_proj

def forward(self, x):

b1 = self.branch1(x)

b2 = self.branch2(x)

b3 = self.branch3(x)

b4 = self.branch4(x)

return torch.cat([b1, b2, b3, b4], dim=1)第三段代码则把这些组件组装成一个可训练的简化版 I3D 分类器,用同一个 toy video task 同时展示学习路径与工程路径:

class MiniI3D(nn.Module):

def __init__(self, num_classes=NUM_CLASSES, dropout=DROPOUT):

super().__init__()

self.stem = BasicConv3d(

3,

D_MODEL,

kernel_size=(3, 7, 7),

stride=(1, 2, 2),

padding=(1, 3, 3),

)

self.pool1 = nn.MaxPool3d(

kernel_size=(1, 3, 3),

stride=(1, 2, 2),

padding=(0, 1, 1),

)

self.block1 = InceptionBlock3D(D_MODEL, 8, 8, 12, 4, 4, 4)

self.block2 = InceptionBlock3D(self.block1.out_channels, 12, 12, 16, 4, 8, 8)

self.pool2 = nn.MaxPool3d(kernel_size=(2, 2, 2), stride=(2, 2, 2))

self.head = nn.Sequential(

nn.AdaptiveAvgPool3d((1, 1, 1)),

nn.Flatten(),

nn.Dropout(dropout),

nn.Linear(self.block2.out_channels, num_classes),

)

def forward(self, x):

x = self.stem(x)

x = self.pool1(x)

x = self.block1(x)

x = self.block2(x)

x = self.pool2(x)

return self.head(x)如果你是在准备面试或论文复现,这份 Notebook 的价值不只是“能跑通”,而是它把 I3D 的关键结构拆得足够清楚:每个张量如何在时间维上传播、为什么要延后时间池化、为什么 2D 预训练能迁移到 3D,都能在代码里直接看到。

参考文献

- Carreira, J., & Zisserman, A. (2017). Quo Vadis, Action Recognition? A New Model and the Kinetics Dataset. CVPR 2017.

- 配套代码实战 Notebook. I3D Code Notebook.

- 李沐. I3D 论文精读. Bilibili.